Detectar algoritmos machistas, racistas o ‘LGTBIfóbicos’. Explicar cómo funciona la inteligencia artificial y aumentar la confianza en los modelos matemáticos. Esta es la revolucionaria idea de la ‘start-up’ fundada por el joven logroñés Pablo Vitoria y otros dos socios, la primera de Europa especializada en combatir los peligros, la falta de transparencia y los retos de la inteligencia artificial.

Expai, la compañía en cuestión, explica que «Amazon comenzó en 2014 a usar un algoritmo para ahorrar tiempo a la hora de contratar personal. La herramienta de la compañía prometía ser más rápida y objetiva. El problema es que la inteligencia artificial había sido entrenada con los datos sobre las solicitudes de empleo de los últimos 10 años, un periodo en el que la mayoría de los programadores contratados habían sido hombres». Así, «el algoritmo aprendió, por lo tanto, que los mejores candidatos tenían que ser hombres y, cuando detectaba un currículum de una mujer, lo penalizaba. Amazon tardó un año en darse cuenta de que estaba empleando una herramienta que reproducía un sesgo machista».

El joven logroñés, de 21 años, explica que aquel no fue un caso aislado, ya que «cada día, miles de empresas y Administraciones dejan en manos de los algoritmos millones de decisiones que reproducen discriminaciones. Por eso, la ‘start-up’ fundada junto a otros dos socios ha creado una metodología para detectar y corregir estos sesgos «de forma rápida, visual e intuitiva».

«Los algoritmos sesgados no solo perpetúan una injusticia social, sino que también generan unos resultados negativos para las empresas y las administraciones, ya que el algoritmo no toma la decisión más óptima», explica el malagueño Javier Rando, otro de los fundadores de la compañía.

«Opacidad y complejidad» de los algoritmos

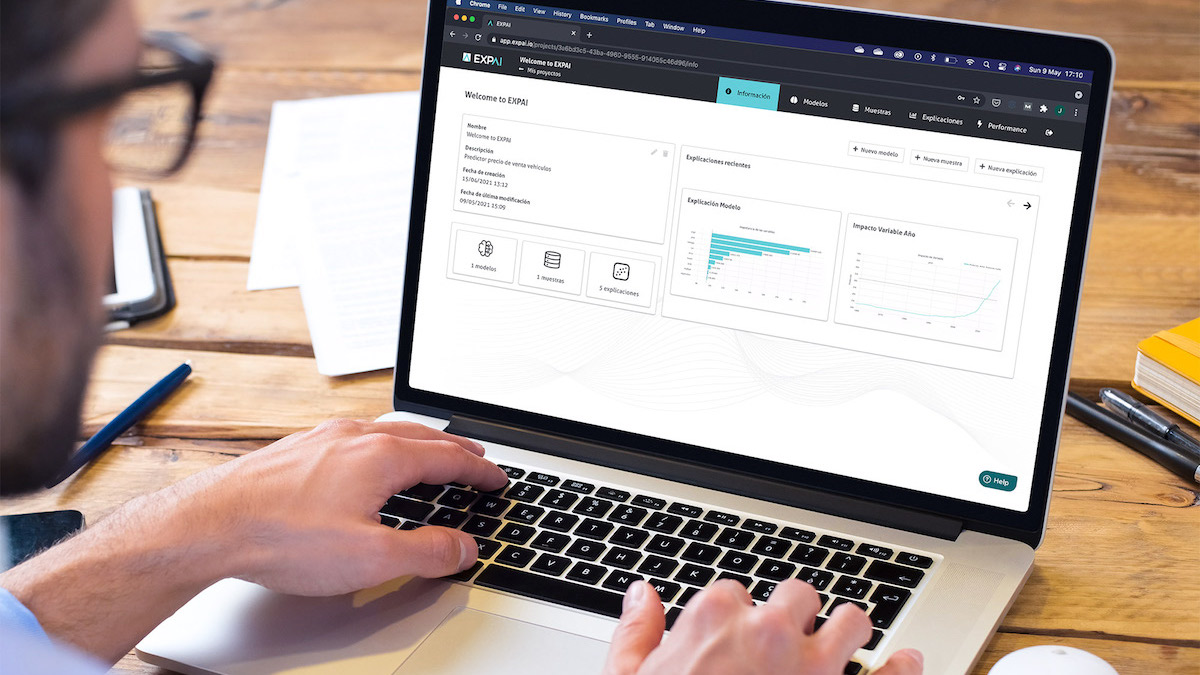

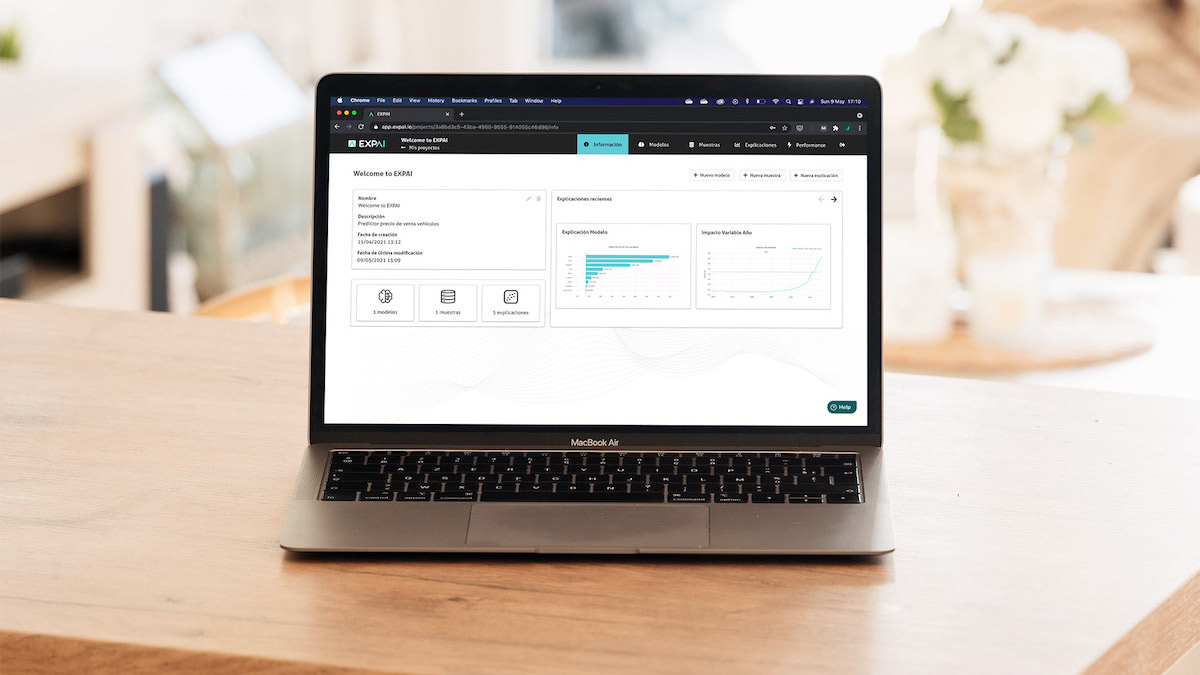

La ‘start-up’ con sede en Barcelona no solamente trabaja en la creación de herramientas matemáticas basadas en la justicia social, sino también en la mejora de la eficiencia y la comprensión de la inteligencia artificial. «Cuando una empresa implementa un sistema de inteligencia artificial lo hace porque, generalmente, quiere agilizar y perfeccionar un determinado proceso. El problema es que, debido a la opacidad y la complejidad de los algoritmos, no siempre entiende el funcionamiento del modelo. Es decir, la empresa gana velocidad, pero pierde capacidad para entender por qué ha tomado una u otra decisión», advierte el Pablo Vitoria, que estudia en la International Business Economics de la Universidad Pompeu Fabra.

El objetivo de ‘Expai’ es permitir a las empresas y las Administraciones verificar que sus modelos matemáticos funcionan correcta o incorrectamente e identificar errores o sesgos, pero también potencialidades para sacar el máximo partido a los algoritmos.

El canario de 26 años Daniel Hormigo, ingeniero de datos y cofundador de la ‘start-up’, pone el énfasis en la importancia de explicar el funcionamiento de la inteligencia artificial: «Trabajé en una empresa que usaba un algoritmo para identificar las probabilidades de que un cliente contratase un nuevo producto. Sin embargo, el equipo comercial desconfiaba del modelo porque no entendían su funcionamiento y, al final, dejaron de usarlo para seguir con técnicas más lentas e imprecisas».

Los tres jóvenes creen que las empresas no se pueden permitir más ejemplos como este ni como el de Amazon: «La diferencia entre entender cómo funciona la inteligencia artificial y desconocer sus peligros es la posibilidad, por un lado, de perpetuar discriminaciones y, por otro, de gastar recursos económicos y tiempo de forma ineficiente. En Expai trabajamos por una inteligencia artificial más comprensible, segura y justa».